Notes

Quels usages de l’intelligence artificielle dans la mise en place de systèmes de suivi et évaluation ?

Objectifs

- Apprendre à apprendre

- Utilisation de l’IA comme amplificateur des projets

- Passer d’un usage de l’évaluation en lien avec la conformité à un usage en lien avec la créativité

- aider à construire des outils qui améliorent les programmes et politiques publiques

Caractéristiques

- L’évaluation devient prédictive et continue, plus que rétrospective

- L’IA identifie en continu les trajectoires atypiques et déclenche des interactions qualitatives pour comprendre les raisons d’un succès ou d’une difficulté

- La boucle d’apprentissage devient quasi-instantanée.

- L’évaluation n’est plus une activité distincte mais le système nerveux central et adaptatif du programme.

Applications

- Automatisation d’une partie de l’analyse des dossiers de candidature aux appels à projets

- Automatisation d’une partie de la réponse aux candidatures aux appels à projets

- Méta-analyse en temps réel des évaluations

- Articuler aide formelle et solidarités locales

L’essentiel de la solidarité humaine est « souterraine » et échappe aux radars, l’aide informelle est souvent plus rapide, plus massive et plus agile, si les ONG et les pouvoirs publics peuvent voir cette carte de l’aide informelle, ils peuvent allouer leurs ressources là où il y a des manques.

- Adapter le type de ressources

Une carte de l’aide informelle assisté par IA permet aux grandes organisations de voir la société non pas comme une masse de victimes passives attendant de l’aide, mais comme un organisme vivant, déjà en train de lutter et de s’entraider, et de se demander : « Comment pouvons-nous soutenir et amplifier le plus intelligemment possible » ?

Architecture de confiance : vers une délégation progressive et conditionnelle

Pour concilier l’agilité opérationnelle et la sécurité des systèmes d’intérêt général, le passage d’une validation manuelle à une délégation sous surveillance ne s’envisagerait que de manière graduelle, subordonnée à une phase d’apprentissage rigoureuse. Ce modèle de « double verrouillage éthique » nécessiterait d’abord de déconstruire l’activité en micro-décisions classées par niveau de risque, de la tâche administrative anodine, comme vérifier la présence d’une pièce jointe obligatoire, à des degrés d’arbitrage plus complexe. L’autonomie de l’IA ne serait accordée qu’après une série probatoire de centaines de validations humaines réussies sur chaque micro-tâche, et potentiellement à la suite d’ateliers de classification où les agents publics définiraient eux-mêmes chaque frontière éthique. Ainsi, l’automatisation ne se déploierait que sur des périmètres validés comme sans enjeu vital, encadrée par des alertes et un suivi humain systématique, garantissant que la technologie reste un amplificateur sous contrôle strict plutôt qu’une boîte noire.

En mai 1861, Henri Fayol est un jeune ingénieur de 20 ans embauché aux houillères de Commentry. Dans son journal, il raconte qu’un cheval s’est cassé la jambe au puits Saint-Edmond. Faute de pouvoir acheter un remplaçant sur place (l’autorisation devait remonter à la direction centrale à Paris pour signature), l’extraction du charbon s’est arrêtée, causant une perte financière bien supérieure à l’achat d’une nouvelle bête. Cette anecdote participe à l’élaboration de sa pensée sur les dysfonctionnements d’une hiérarchie privée de délégation. Mais encore, à sa collecte de « faits manqués » de l’administration. Aujourd’hui comme en 1861, ces faits manqués demandent à être documentés dans le cadre du déploiement d’agents IA potentiellement autonomes. Voir le projet I-Delphi.

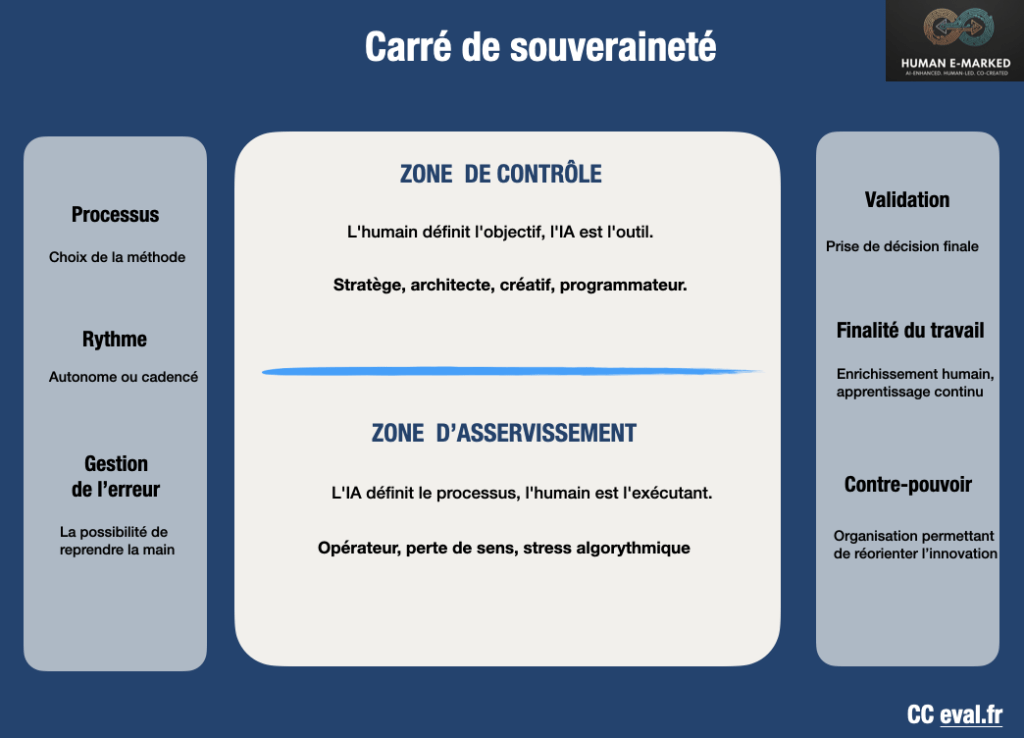

Carré de la souveraineté IA